文章目录

- 期望

-

- 样本空间

- 我对期望的数学直觉

-

- 期望的一般计算方法

- 期望的性质

- 方差

-

- 方差的数学直觉

- 方差的数学定义

- 方差的推论

- 方差的性质

- 协方差与相关系数

-

- 协方差

-

- 定义

- 计算方法

- 性质

- Pearson相关系数

-

- 定义

- 性质

- 协方差矩阵与相关系数矩阵

-

- 定义

- 作用

期望

样本空间

我们将随机实验E的一切可能基本结果(或实验过程如取法或分配法)组成的集合称为E的样本空间,记为S。样本空间的元素,即E的每一个可能的结果,称为样本点。

我对期望的数学直觉

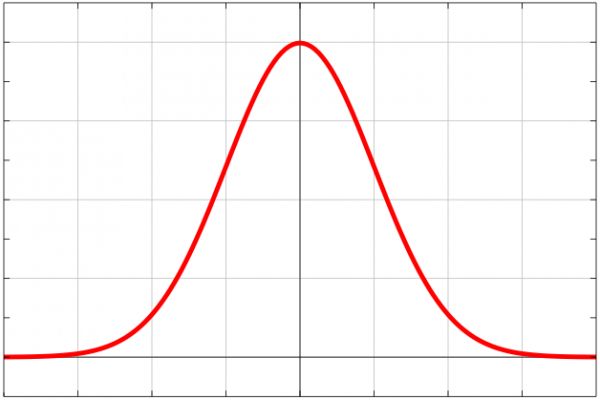

这样思考一下,如果某个数据集 X X X满足它是某个分布的随机采样,那么在采样过程中最可能出现的值是多少?拿标准正态分布来说,这个最可能出现的值就是中间的值。这个实际上是一种统计平均。在计算中也是使用统计平均的方式(即加权平均)来计算的,加上的权值就是该样本可能出现的概率。

期望的一般计算方法

若我们的样本集为: X X X,则:

- 连续型

对于一个连续的分布来说,如果它的概率密度函数是 f ( x ) f(x) f(x),那么:

E ( X ) = ∫ x f ( x ) d x E(X)=\int{}xf(x)dx E(X)=∫xf(x)dx

- 离散型

对于离散的数据集来说,如果把数据集中的每一个样本都看作总数据集上的随机采样的话,那么每一个样本点被采到的概率就是一样的,同时依据大数定理,只要我们采取的次数足够多,那么数据采集到的频率就可以近似为数据可能出现的概率。那么我们就有:

E ( X ) = ∑ i x i p i = 1 n ∑ i x i E(X)=\sum_i{}x_ip_i=\frac{1}{n}\sum_{i}x_i E(X)=i∑xipi=n1i∑xi

期望的性质

- E ( k X ) = k E ( X ) E(kX)=kE(X) E(kX)=kE(X)

- E ( X + Y ) = E ( X ) + E ( Y ) E(X+Y)=E(X)+E(Y) E(X+Y)=E(X)+E(Y)

-

若 X 、 Y X、Y X、Y相互独立,则 E ( X Y ) = E ( X ) E ( Y ) E(XY)=E(X)E(Y) E(XY)=E(X)E(Y),反之不成立,只能说明 X 、 Y X、Y X、Y不相关

对于最后一个性质,这里先给出一个粗浅的解释,如果我们把 x 、 y x、y x、y看作两个随机变量(在现实中大部分情况还真是), x 、 y x、y x、y相互独立代表这两个随机变量的各自变化不会影响到另一个随机变量的变化,称之为相互独立,而不相关只能说明两个随机变量在一维空间上的“相互独立”,也就是两个变量之间不存在线性关系,在其他维度空间上可能会不独立,也就是说两个变量可能存在非线性的关系,特别的,对于二维正态随机变量,不相关等价于独立。

方差

方差的数学直觉

对于一个随机变量 x x x,对于 x x x进行随机采样我们可以得到数据集 X X X,如果可以使用某个分布来描述这个数据集 X X X的情况的话,那么方差就可以用来描述这个分布的发散程度,数据分布越发散,其期望越不稳定,这个分布本身也就越不稳定。

方差的数学定义

- 定义式、计算式

V a r ( x ) = E { [ X − E ( X ) ] 2 } = E ( X 2 ) − E 2 ( X ) Var(x)=E\{[X-E(X)]^2\}=E(X^2)-E^2(X) Var(x)=E{[X−E(X)]2}=E(X2)−E2(X)

对于离散型数据来说,方差可以这样来计算:

V a r ( x ) = ∑ i ( x i − x ˉ ) ( x i − x ˉ ) n − 1 Var(x)=\frac{\sum_i(x_i-\bar{x})(x_i-\bar{x})}{n-1} Var(x)=n−1∑i(xi−xˉ)(xi−xˉ)

这里的 n − 1 n-1 n−1是为了使计算得到的方差没有偏差(无偏)

标准差:方差取根号是标准差

方差的推论

E { [ X − E ( X ) ] 2 } > 0 ⇒ E ( X 2 ) ≥ E 2 ( X ) E\{[X-E(X)]^2\}>0\Rightarrow{}E(X^2)\geq{}E^2(X) E{[X−E(X)]2}>0⇒E(X2)≥E2(X),当 X X X取定值的时候,取等号。

方差的性质

- V a r ( c ) = 0 Var(c)=0 Var(c)=0

- V a r ( X + c ) = V a r ( X ) Var(X+c)=Var(X) Var(X+c)=Var(X)

- V a r ( k X ) = k 2 V a r ( X ) Var(kX)=k^2Var(X) Var(kX)=k2Var(X)

- X X X和 Y Y Y独立

V a r ( X + Y ) = V a r ( X ) + V a r ( Y ) Var(X+Y)=Var(X)+Var(Y) Var(X+Y)=Var(X)+Var(Y)

协方差与相关系数

协方差

协方差是两个随机变量变化具有相同变化趋势的度量,注意,协方差在这里统计的两个变量是属于同一个数据集的,在每一步计算的时候,计算引入的两个随机变量的值都属于同一个样本点。

- 如果为正,则这两个变量正相关(同时变大、变小)

- 如果为负,则这两个变量负相关(一个变大时另一个变小)

- 如果为零则不相关吗(线性独立)

定义

C o v ( X , Y ) = E { [ X − E ( X ) ] [ Y − E ( Y ) ] } Cov(X,Y)=E\{[X-E(X)][Y-E(Y)]\} Cov(X,Y)=E{[X−E(X)][Y−E(Y)]}

计算方法

C o v ( X , Y ) = ∑ i ( x i − x ˉ ) ( y i − y ˉ ) n − 1 Cov(X,Y)=\frac{\sum_i(x_i-\bar{x})(y_i-\bar{y})}{n-1} Cov(X,Y)=n−1∑i(xi−xˉ)(yi−yˉ)

性质

- C o v ( X , Y ) = C o v ( Y , X ) Cov(X,Y)=Cov(Y,X) Cov(X,Y)=Cov(Y,X)

- C o v ( a X + b , c Y + d ) = a c C o v ( X , Y ) Cov(aX+b,cY+d)=acCov(X,Y) Cov(aX+b,cY+d)=acCov(X,Y)

- C o v ( X 1 + X 2 , Y ) = C o v ( X 1 , y ) + C o v ( X 2 , Y ) Cov(X_1+X_2,Y)=Cov(X_1,y)+Cov(X_2,Y) Cov(X1+X2,Y)=Cov(X1,y)+Cov(X2,Y)

- C o v ( X , Y ) = E ( X Y ) − E ( X ) E ( Y ) Cov(X,Y)=E(XY)-E(X)E(Y) Cov(X,Y)=E(XY)−E(X)E(Y)

- 协方差的上界

若 V a r ( X ) = σ 1 2 Var(X)=\sigma_1^2 Var(X)=σ12、 V a r ( Y ) = σ 2 2 Var(Y)=\sigma_2^2 Var(Y)=σ22,则: ∣ C o v ( X , Y ) ∣ ≤ σ 1 σ 2 |Cov(X,Y)|\leq\sigma_1\sigma_2 ∣Cov(X,Y)∣≤σ1σ2

Pearson相关系数

定义

− 1 ≤ ρ X Y = C o v ( X , Y ) V a r ( X ) V a r ( Y ) ≤ 1 -1\leq\rho_{XY}=\frac{Cov(X,Y)}{\sqrt{Var(X)Var(Y)}}\leq{}1 −1≤ρXY=Var(X)Var(Y)

Cov(X,Y)≤1

性质

这里看一下前面的协方差的上界有关内容就可以知道,Pearson相关系数只是把协方差归一化了一下(当年出个成果真简单/误),若 ∣ ρ X Y ∣ = 1 |\rho_{XY}|=1 ∣ρXY∣=1,那么 X 、 Y X、Y X、Y具有绝对线性关系,若 ∣ ρ X Y ∣ = 0 |\rho_{XY}|=0 ∣ρXY∣=0,则 X 、 Y X、Y X、Y绝对不具有线性关系。

协方差矩阵与相关系数矩阵

定义

对于n个随机向量

C = [ c 11 ⋯ c 1 n ⋮ ⋱ ⋮ c n 1 ⋯ c n n ] C= \begin{bmatrix} c_{11} & \cdots & c_{1n} \\ \vdots & \ddots & \vdots \\ c_{n1} & \cdots & c_{nn} \end{bmatrix} C=⎣⎢⎡c11⋮cn1⋯⋱⋯c1n⋮cnn⎦⎥⎤

作用

协方差矩阵的意义在于使用简洁的矩阵表示了数据特征之间的一些关系,并且协方差矩阵具有许多很好的特性,便于计算。这里我们可以引申到相关系数矩阵。

无论是协方差矩阵或者是相关系数矩阵,他们都可以描述随机变量之间的线性关系。

- 协方差矩阵是实对称阵

实对称阵:

实对称阵有很多有用的性质。

比如若有 n n n阶实对称阵 A A A,则必有正交矩阵 P P P,使得:

P − 1 A P = P T A P = Λ P^{-1}A{}P=P^{T}A{}P=\Lambda P−1AP=PTAP=Λ

其中 Λ \Lambda Λ为以 A A A的 n n n个特征值为对角元的对角矩阵

这个性质就很适合我们基于协方差矩阵去做 P C A PCA PCA(主成分分析)